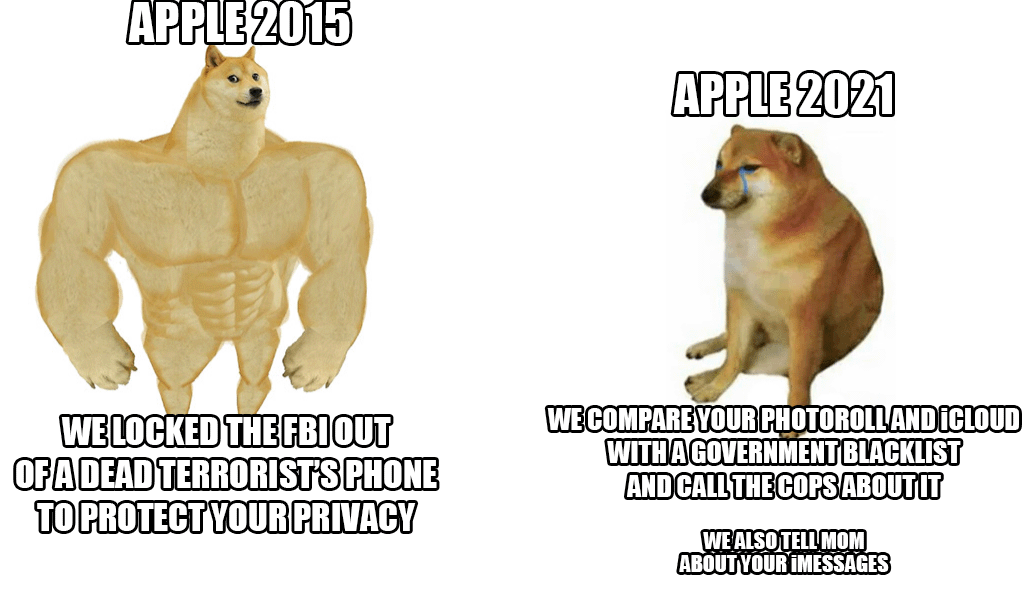

У канцы мінулага тыдня Apple прадставіла новую сістэму барацьбы з жорсткім абыходжаннем з дзецьмі, якая будзе сканаваць фатаграфіі практычна ўсіх у iCloud. Нягледзячы на тое, што на першы погляд ідэя гучыць нядрэнна, бо дзяцей сапраўды трэба абараніць ад гэтага дзеяння, тым не менш, гігант з Куперціна падвергся лавіне крытыкі - не толькі з боку карыстальнікаў і экспертаў па бяспецы, але і з боку саміх супрацоўнікаў.

Паводле апошняй інфармацыі аўтарытэтнага агенцтва Reuters шэраг супрацоўнікаў выказалі сваю занепакоенасць гэтай сістэмай ва ўнутраным паведамленні на Slack. Маўляў, яны павінны баяцца магчымых злоўжыванняў з боку ўладаў і ўрадаў, якія маглі б злоўжываць гэтымі магчымасцямі, напрыклад, для цэнзуры людзей ці асобных груп. Адкрыццё сістэмы выклікала моцную дыскусію, якая ўжо мае больш за 800 асобных паведамленняў у вышэйзгаданым Slack. Адным словам, супрацоўнікі хвалююцца. Нават экспэрты ў галіне бясьпекі раней зьвярталі ўвагу на тое, што ў чужых руках гэта будзе сапраўды небясьпечная зброя для падаўленьня актывістаў, згаданай імі цэнзуры і таму падобнага.

Добрай навіной (пакуль) з'яўляецца тое, што навінка стартуе толькі ў ЗША. На дадзены момант нават незразумела, ці будзе сістэма выкарыстоўвацца таксама ў краінах Еўрасаюза. Тым не менш, нягледзячы на ўсю крытыку, Apple стаіць за сябе і абараняе сістэму. Перш за ўсё ён сцвярджае, што ўся праверка адбываецца ў прыладзе, і калі супадзенне ёсць, толькі ў гэты момант корпус зноў правяраецца супрацоўнікам Apple. Толькі на яго меркаванне ён будзе перададзены ў адпаведныя органы.

Гэта можа быць зацікавіць вас

Я не хацеў бы пераходзіць з iCloud на нешта бяспечнае і сапраўды прыватнае, але калі Apple будзе настойваць, я ўсё роўна перастану ім плаціць.

Ён будзе дзейнічаць (пакуль) толькі ў ЗША

Насамрэч няважна, дзе гэта будзе дзейнічаць заканадаўча. Гэтая тэхналогія ўжо будзе і разгорнута. Гэта самая вялікая рызыка.